Ficción, relato e impacto económico

Narrativas alienígenas que cotizan en bolsa

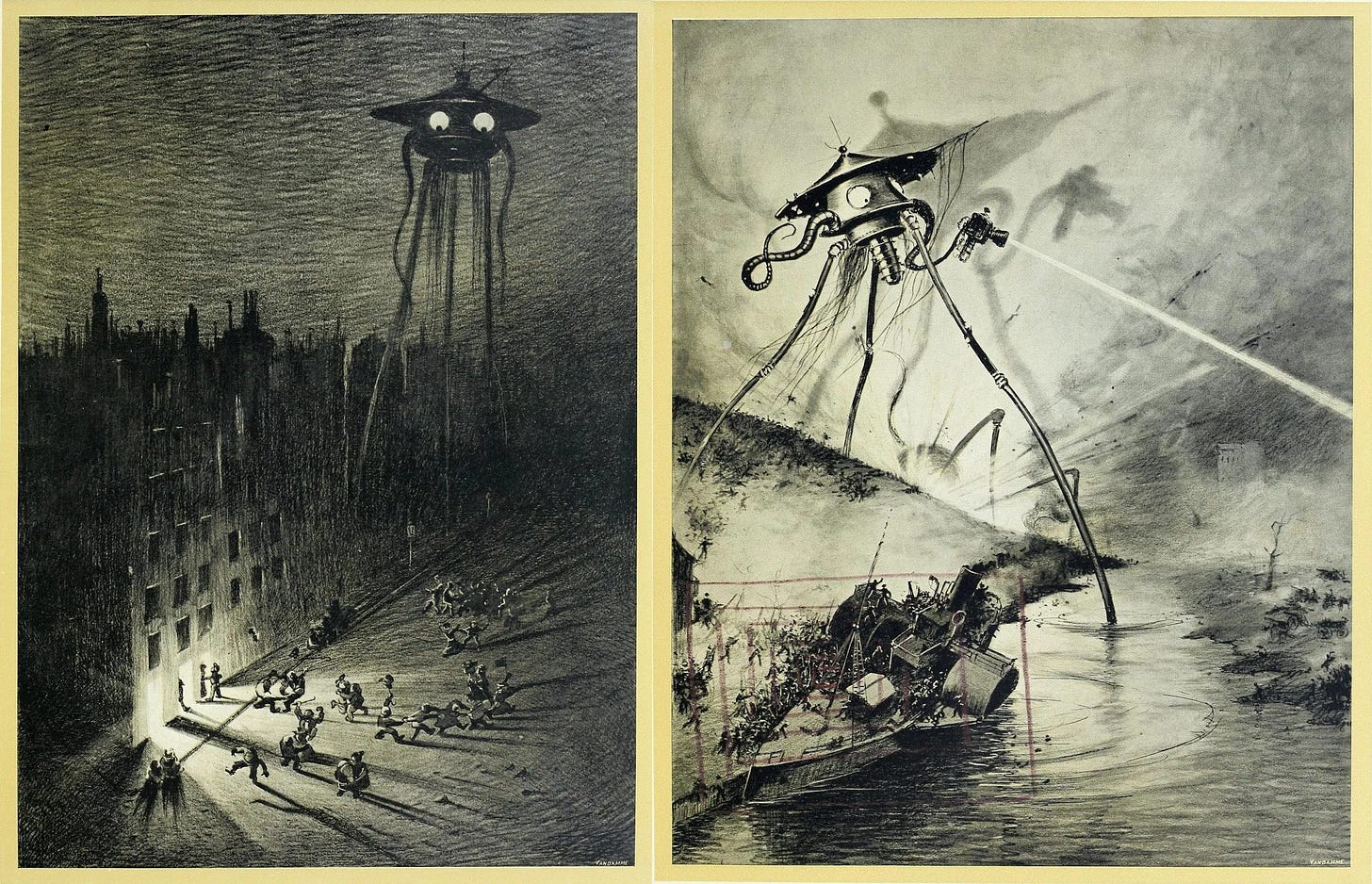

En 1938, la noche del 30 de octubre, una adaptación radiofónica de La guerra de los mundos de H. G. Wells dirigida y narrada por Orson Welles descolocó a una gran parte de la audiencia: el programa imitaba boletines de última hora y narraba una invasión alienígena en tiempo real, situada en Nueva Jersey. El relato radiofónico describía con el nervio de un parte de emergencia los “rayos de calor”, el pánico en la carretera y las nubes de un humo letal. El recuerdo de la Gran Guerra, teñida de gases mostaza, resonaba en aquellos años de ansiedad prebélica. El mundo ya olía a una nueva guerra. Y fue inevitable que algunos oyentes interpretaran la ficción como una noticia real.

La radio, indudablemente, no inventó el miedo aquella noche, pero extendió la capacidad de la ficción para impactar de forma persuasiva. Estados Unidos vivía con la respiración contenida ante la inestabilidad europea, la expansión de los totalitarismos y la memoria aún fresca de la Gran Depresión. La invasión marciana funcionó como un espejo que devolvía la proyección de un vacío emocional en una sociedad que se entrenaba para esperar noticias graves. Y no era necesario ver para creer. Algo que nos puede resultar curiosamente familiar. Bastó una voz creíble catalizada por la tecnología para sincronizar un estado de alarma social en multitud de hogares.

La recién inaugurada comunicación de masas habilitada por la tecnología constituía una fábrica de expectativas compartidas. Bien lo sabían en aquellos años Mussolini, Hitler o el propio Churchill subidos a lomos de sus micrófonos y de la radio. Desde el telégrafo hasta internet, cada innovación ha acelerado la circulación del mensaje y su impacto sobre la estructura social, que aun así requiere de la credibilidad para habilitarlo. La radio facilitó, además, una dimensión nueva en esa credibilidad: El telégrafo había comprimido el espacio y el tiempo, pero seguía siendo texto descarnado y frío, mientras que la radio añadió con la vibración de la voz humana la emocionalidad, el temblor, la urgencia, la pausa dramática. Convirtió la información en un acontecimiento acústico que ya no se limitaba a acariciar tangencialmente las emociones. Llegaba a manosearlas.

La arquitectura del boletín informativo fue el verdadero dispositivo de verosimilitud. Interrupciones musicales, conexiones en directo, testigos improvisados, expertos que analizaban la situación: el formato imitaba abiertamente al parte de guerra, valiéndose de la autoridad casi sacramental de la que gozaba el noticiario radiofónico. La ficción se vistió con los ropajes de la actualidad, lo que apremiaba la atención. El qué se revistió con el disfraz fundamental del cómo se decía. La sociedad aún no había desarrollado anticuerpos frente a la manipulación del formato. La alfabetización mediática era incipiente y la confianza casi automática. Y la propaganda estaba en pleno auge, como bien nos ha contado Miguel García Álvarez.

La radio estaba sirviendo como una tecnología de sincronización emocional a gran escala, escuchando y reaccionando en un mismo registro afectivo, lo que empañaba la racionalidad. Esa simultaneidad creó comunidad y capacidad de orquestación de grandes — y a veces terribles — empresas. Pero también creó vulnerabilidad, al facilitar mediante la infraestructura técnica el alineamiento de percepciones con una precisión y agilidad inéditas. La supuesta invasión marciana fue un experimento involuntario que demostraba, una vez más en la historia, que cuando una sociedad comparte canal, comparte también latido. Y que la credibilidad del mensaje, más allá de su verdad, depende en gran medida de la legitimidad percibida del dispositivo que lo transmite. Pero esta no sería ni la primera, ni mucho menos la última vez que sucedería. Con un impacto real en los bolsillos. Incluso hoy.

La reacción de los mercados al relato

Dicen que las historias son el caballo de Troya de la comunicación. Penetran en la mente por intersticios que los datos no son capaces de traspasar, pero por los que sí fluyen los relatos de sentido. Desde la infancia organizamos el mundo en tramas, y nuestra memoria no archiva datos tan bien como conserva escenas, especialmente las que nos provoquen emociones. Por eso gran parte del conocimiento humano, desde la religión hasta la macroeconomía, se articula como relato. Las cifras exigen un esfuerzo cognitivo mayor, mientras que las historias, alumbradas al calor que nos forjó como especie, se dejan habitar. Y cuando el relato introduce números en su interior, estos dejan de ser abstracciones para convertirse en andamiajes y asideros que refuerzan un destino lógico narrativo. La historia no solo adorna el argumento, sino que lo hace memorable, lo dota de causalidad y lo proyecta hacia el futuro. Multiplica el interés porque multiplica la inteligibilidad.

Como es bien sabido, los mercados reaccionan así a los relatos verosímiles que reconfiguran sus expectativas. Daniel Kahneman dedicó una vida entera a explicar cómo nuestra mente, arrinconando sesudas hojas de cálculo, compra a través de historias plausibles que ordenan la incertidumbre. En los mercados de divisas abundan los ejemplos: cuando en 1992 George Soros apostó contra la libra esterlina, fue esencial la construcción del relato que pintaba a un Reino Unido incapaz de sostener el tipo de cambio dentro del Mecanismo Europeo hasta precipitar el “miércoles negro”. Treinta años después, tras la réplica del primer seísmo de la Gran Recesión, el presidente del BCE, Mario Draghi, pronunciaba en julio de 2012 su célebre “whatever it takes” — haremos lo que haga falta — para que el euro, automáticamente, se estabilizase en los mercados sin que el BCE hubiera comprado aún un solo bono: la frase actuó como ancla narrativa que reorganizó las expectativas sobre la supervivencia de la moneda amenazada por la especulación en torno a la deuda de varios de los países europeos más lastrados por la crisis, entre otros, España.

Algo similar ocurre cada trimestre en las salas de resultados empresariales. Dos compañías pueden presentar cifras casi idénticas y, sin embargo, experimentar reacciones bursátiles opuestas. El mercado escucha el tono, escruta el guidance, calibra la historia que la dirección cuenta sobre el futuro, y suele descontarlo. En 2013, por ejemplo, los resultados de Apple superaron las previsiones, pero la acción cayó ante un relato percibido como conservador. En cambio, Tesla ha vivido recurrentes sesiones de euforia tras cifras modestas cuando la narrativa ha sido capaz de proyectar la expansión disruptiva propia del tecnoptimismo de Musk.

Más allá del número, importa la trama que lo envuelve. La valoración no descuenta el presente, sino el futuro imaginado colectivamente. Y además lo hace en múltiples capas. Porque somos seres tan hipersociales que los relatos no sólo nos hablan de los hechos, sino de las expectativas de los demás. Por eso, como apuntaba Keynes, los inversores valoran los activos por lo que creen que el mercado, a su vez, creerá mañana. En su metáfora del concurso de belleza, quienes tratan de predecir el rostro ganador no lo hacen porque sea objetivamente más atractivo, sino porque pueden percibirlo como el favorito de los demás participantes, en un equilibrio de Nash. La amplificación de estas capas secundarias y a veces terciarias de anticipación convierten a la narrativa en un vector crítico: pequeñas variaciones en el relato dominante pueden amplificarse en cascada porque cada agente trata de adelantarse a la reacción de los otros. De ahí que los titulares, tonos y marcos interpretativos sirvan, más allá del ruido, como señales que coordinan creencias y, con ellas, precios.

Pero los actores no tienen que ser necesariamente personajes involucrados en las organizaciones económicas para tener un efecto económico perceptible. En la Eurocopa celebrada en 2021 a causa de la pandemia, Cristiano Ronaldo asistió a una conocida rueda de prensa que se volvió famosa antes de que se formulara una sola pregunta. Al sentarse antes de atender las preguntas de los periodistas, apartó con cierto desdén dos botellas de Coca-Cola que se encontraban frente a él de cara a las cámaras, y levantando una de agua dijo reivindicativamente “agua”. La interpretación inmediata fue la de un desaire a la marca, y horas después las cotizaciones de la compañía caían varios miles de millones de dólares. Hay voces que han discutido esta causalidad, porque la caída intradía fue relativamente contenida y la acción recuperó después, pero el caso es ilustrativo: un gesto simbólico de alguien ajeno con suficiente credibilidad entre el público, amplificado por la cobertura mediática global, puede activar narrativas sobre salud, consumo y reputación que se reflejan de inmediato en los precios.

Y todo este poder del relato, incluso del más ficticio, se encuentra inevitablemente presente en el desarrollo de la IA, donde en los últimos años estamos observando su extremada relevancia para captar la atención y los fondos necesarios para su crecimiento. Y ese poder está profundamente articulado por la viralidad digital, como en su día fuera la radio para Welles, que sirve hoy para expandir los relatos que modulan enormes fluctuaciones en las valoraciones empresariales y las cotizaciones bursátiles. Las comunicaciones de masas siguen acopladas a los mercados financieros a través de la palabra. Valgan dos ejemplos recientes: La crisis global de inteligencia y el cibergedón.

La crisis global de inteligencia

Como en el caso de la guerra de los mundos de Orson Wells, hace unas semanas conocíamos a través de esta misma plataforma de Substack otra historia de ciencia ficción sobre los efectos desfavorables del contacto de una inteligencia no humana con la Tierra, esta vez bajo la forma de la IA. Un artículo publicado por Citrini Research — una firma independiente de análisis financiero y geopolítico razonablemente desconocida — titulado “La crisis global de inteligencia 2028” describía un escenario futuro muy próximo en el que una escalada en el crecimiento de las capacidades cognitivas de la IA había provocado un inicial crecimiento de la productividad seguido de un socavón en la economía, desplazando a miles de trabajadores y desencadenando una recesión masiva.

El núcleo del artículo se centraba en una idea aparentemente simple pero de gran potencia disruptiva: la deflación del trabajo cognitivo. Si la inteligencia artificial reduce de forma drástica el coste marginal de tareas como el análisis financiero, la programación, la consultoría o incluso la investigación científica, el valor económico de esas capacidades tiende a comprimirse. Las empresas, enfrentadas a una abundancia súbita de inteligencia barata, recortan gasto en servicios profesionales, ajustan plantillas y presionan los salarios a la baja. Esta dinámica se traslada rápidamente a los márgenes empresariales, particularmente de todos los intermediarios cognitivos: lo que antes era una ventaja competitiva basada en capital humano cualificado se convierte en una commodity accesible.

El resultado, en el relato de Citrini, es una cadena de transmisión que va desde la caída del ingreso de los trabajadores cualificados hasta la contracción del consumo agregado, generando un bucle de retroalimentación negativa que desemboca en un desempleo estructural superior al 10%, una caída del 38% en el S&P 500, una crisis del sistema bancario por impago de hipotecas de profesionales cualificados sin ingresos y en general una recesión económica de envergadura. Planteado como un informe ficticio pero verosímil elaborado en 2028, el artículo describía a posteriori una economía colapsada por un exceso de capacidad cognitiva que no encuentra un mecanismo de absorción suficientemente rápido y desborda a los poderes públicos.

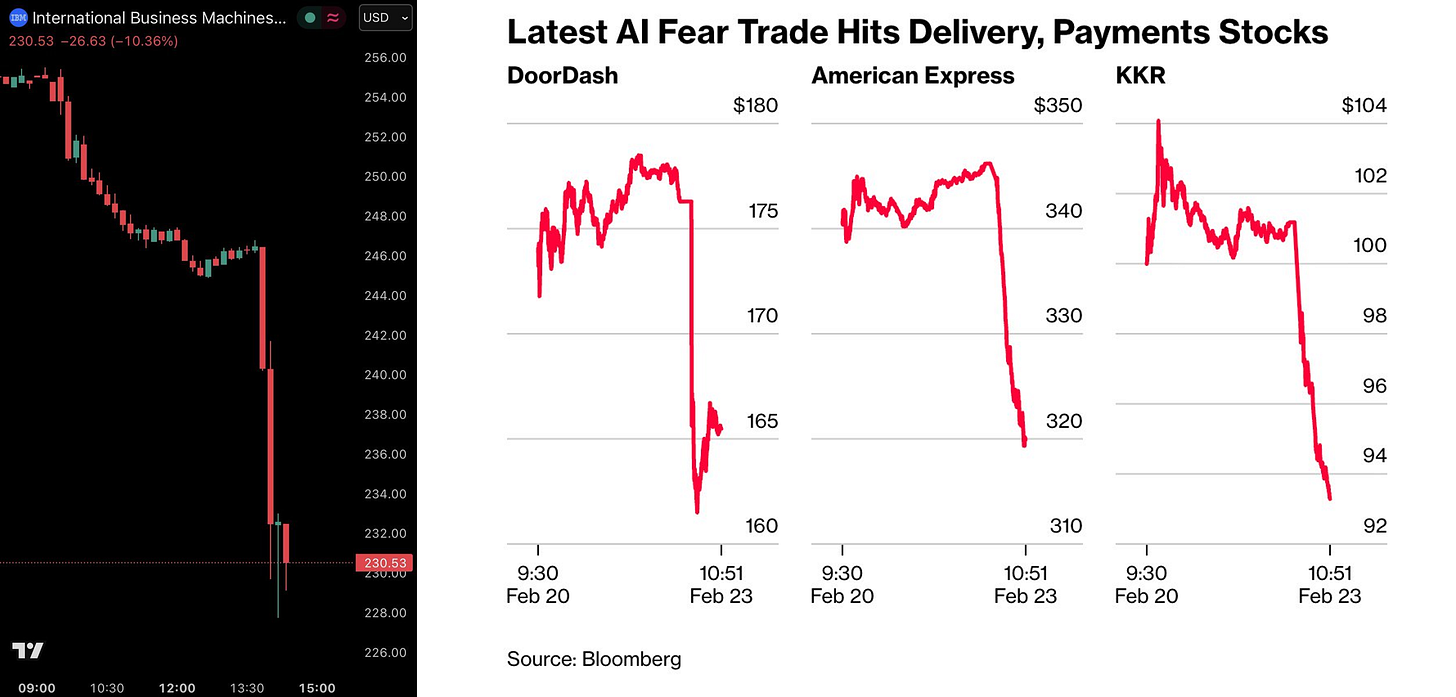

El artículo acumuló más de 16 millones de visualizaciones, a pesar de confesarse como un escenario hipotético y su impacto fue sorprendentemente real. El texto se volvió viral exponiendo la profunda ansiedad de Wall Street sobre el futuro de la IA. El lunes siguiente al relato blogofónico, varias de las empresas citadas directa o indirectamente caían en bolsa más de un 10% en un sólo día, en su peor jornada desde hacía décadas, borrando miles de millones de capitalización. Los titulares muy pronto amplificaron la ansiedad sobre múltiples empresas. Porque, como sucedió con el episodio de Orson Welles, en realidad el relato original no generó tanta histeria de forma directa, sino que fueron los medios los que catapultaron su impacto inicial como acelerantes de un incendio. En aquel momento, en los días posteriores al relato de Welles. Hoy, casi en tiempo real.

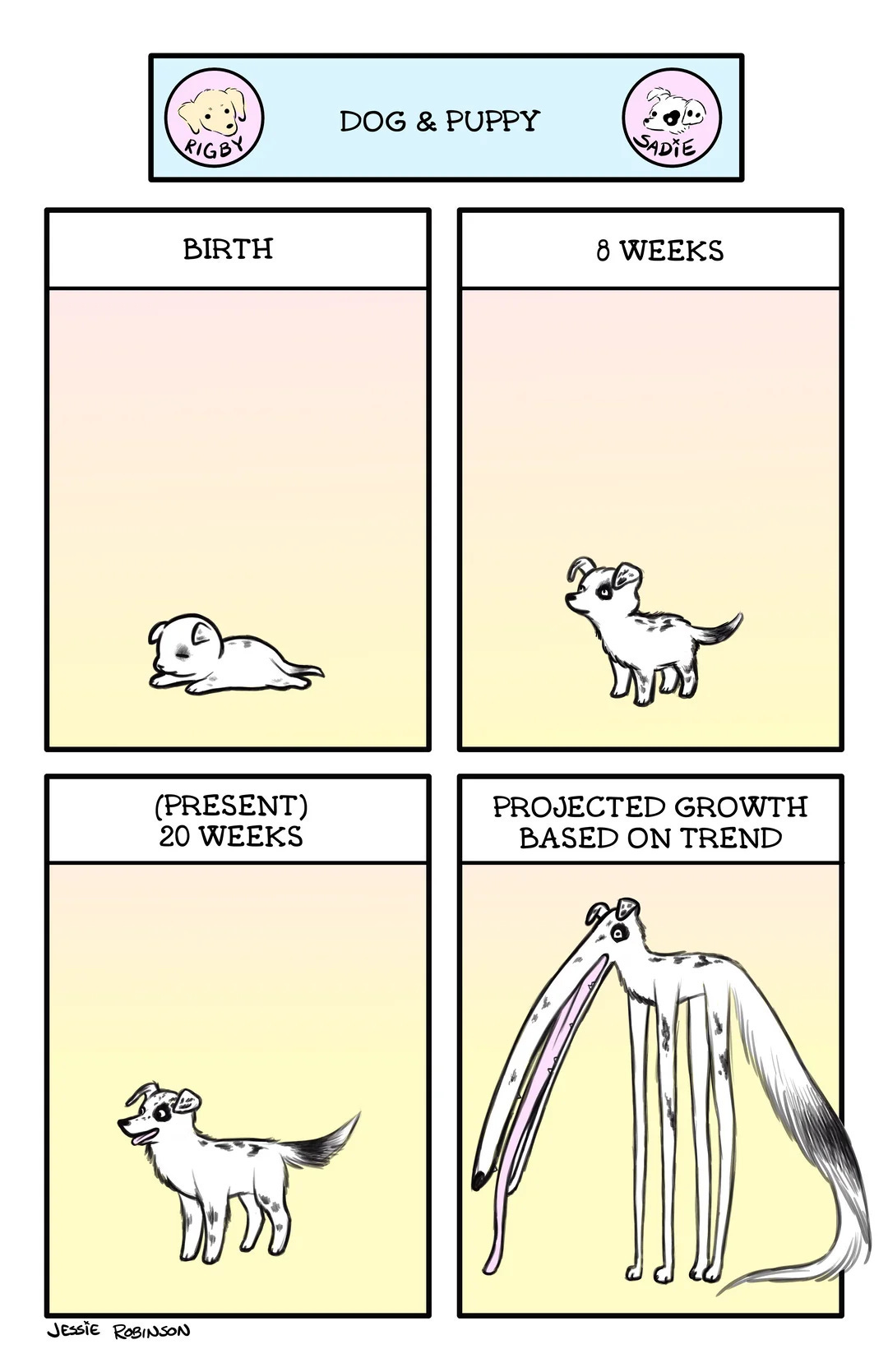

Indudablemente, el relato de Citrini ha merecido varias críticas sosegadas sobre su evidencia empírica y sus hipótesis implícitas, y ha corregido al alza este nuevo episodio inserto en la historia más larga sobre el SaaS apocalypse — el posible derrumbe catastrófico de las empresas de software vendidas como servicio a manos de la IA. El relato rezuma aroma a aquel fenómeno extraterrestre de Welles, con el que la IA parece venir revestida. Sin embargo, la analogía con una inteligencia alienígena sobredimensiona la autonomía de la IA, que hoy sigue siendo infraestructura corporativa bajo gobernanza humana, cuyo futuro depende en realidad de nuestras decisiones. Y extrapola linealmente sus capacidades ignorando los retornos decrecientes y los costes crecientes del escalado. Siempre que leo promesas acerca del crecimiento exponencial, de las leyes de escala, de la inminente singularidad… me viene a la cabeza esta viñeta que representa bien los errores de extrapolar dando por sentado lo que hasta ahora nos había funcionado.

El relato de Citrini dibuja un escenario que descansa en una sustitución casi total e inmediata del trabajo cognitivo que ignora la evidencia histórica: los shocks de productividad rara vez generan colapsos agregados, y la adopción tecnológica sigue curvas en S, con fases iniciales lentas marcadas por fricciones técnicas, organizativas y culturales. Datos recientes apuntan más bien a que el empleo en sectores teóricamente expuestos se mantiene sólido, la demanda de perfiles técnicos crece y el uso de IA en el trabajo avanza de forma contenida. Aunque habrá sin duda damnificados y medidas que tomar, es bastante verosímil pensar que la IA amplificará la productividad individual reconfigurando salarios antes que provocar un colapso abrupto. Además, existen límites materiales y otros aparecerán que el relato omite: la expansión masiva de la computación eleva ya los costes energéticos, generando un suelo que puede preservar el valor relativo del trabajo humano. A ello se suma un argumento económico clave: que una tarea sea técnicamente automatizable no implica que sea óptimo sustituir al humano, ya que la complementariedad — humano más IA — sigue generando más valor en múltiples contextos.

Para que el escenario de Citrini se materializara sería necesario asumir simultáneamente una adopción acelerada que ignore estas dinámicas, una sustitución total del trabajo cualificado, la ausencia de respuesta política, la inexistencia de límites físicos al cómputo y la falta de creación de nuevos empleos. La convergencia de todos estos factores en un horizonte de apenas dos años pertenece más al terreno de la ficción financiera que al del análisis macroeconómico, lo que no invalida su interés, pero sí lo reubica como un relato límite que amplifica tensiones reales. Fernando Polo y Carlos Corredor lo cuentan muy bien aquí.

En el fondo, este episodio revela que la conversación sobre la IA realmente se ha convertido en un mercado de narrativas de ciencia ficción en competencia. El nivel de incertidumbre sobre los efectos económicos de la IA es tan alto — y la calidad y el suministro de información contrastada y en tiempo real sobre sus efectos económicos tan escasos — que incluso las conversaciones serias sobre IA de personas que por lo demás serían analíticas suelen inclinarse más hacia el género de la ficción que hacia la categoría del análisis empírico. El mundo de la IA está tan lleno de ciencia ficción en buena medida porque el espacio carece de datos oficiales de alta calidad.

Pero es que, además, se ignora que buena parte de esta adopción tecnológica pasa precisamente por la genuina capacidad de persuasión humana. Un shock de productividad en el trabajo cognitivo nunca se traduce mecánicamente en contracción agregada. La evidencia histórica sugiere dinámicas más complejas y acompasadas: la mecanización, la electrificación, el software o Internet abarataron costes, sí, pero también expandieron la producción, liberaron renta y crearon nuevas demandas mientras luchaban por abrirse paso entre la adopción social. Sin tener en cuenta, además, la llamada paradoja de Solow que recuerda que la productividad tarda en materializarse en los datos. Pero además, la adopción humana siempre es irregular lo que impide una elasticidad perfecta en la sustitución y la aleja mucho de la velocidad instantánea: la economía no es solo procesamiento de información, sino capital físico, regulación, competencia comercial, confianza institucional y fricciones organizativas que amortiguan cualquier transición. De hecho, si la IA no está teniendo aún efectos más palpables en la economía es precisamente porque somos su principal cuello de botella. Para bien y para mal.

Seremos nosotros los que articulemos la transmisión financiera a la estructura económica. Y no será inmediata, pues la volatilidad del mercado reajusta constantemente expectativas y primas de riesgo. Y además — como he experimentado de primera mano en los mercados de las redes de comunicaciones y de la ciberseguridad —, seguiremos fiándonos de las personas a la hora de comprar, vender y adoptar tecnología. Porque los vínculos de confianza humana son una infraestructura invisible pero bien patente del mercado tecnológico. Porque el éxito de un proceso de adopción tecnológica no es sólo contar con una buena tecnología — no suele haberlas malas en un mercado suficientemente competitivo — sino esencialmente con personas capaces de interactuar a través de procesos, analizando, cuestionando, contextualizando y persuadiendo a los demás de su mejor adquisición, adopción y uso. Por eso mismo, el riesgo de la muerte del junior queda amortiguado: no eran fundamentalmente las “tareas de becario” las que curtían a los iniciados para volverlos senior sino la interacción y el intercambio con un senior que ejerza su influencia y motivación. El factor diferencial sigue siendo humano. Incluido el de armar un relato. Especialmente si estimula en nosotros emociones. Como la del miedo.

El cibergedón

Como todo fenómeno complejo transido de mil relatos, la caída bursátil que provocó en buena medida el artículo de Citrini, y otros sustos recientes, han tenido otros motivos relacionados con otra diversidad de relatos superpuestos que compiten entre sí por la atención de los inversores. El que se haga sobre el desenlace de una tensión geopolítica, una guerra arancelaria o una militar que amenaza a las cadenas de suministro en torno al estrecho de Ormuz es enormemente relevante. Pero también el que se haga sobre la seguridad que protege todas las infraestructuras digitales.

Días antes de que Citrini publicara su famoso artículo, Claude Code Security había demostrado que podía descubrir de manera autónoma más de quinientas vulnerabilidades graves en bibliotecas de código abierto fundamentales como Ghostscript y OpenSC. Este pequeño episodio se sumaba como una muesca más a la construcción del poderoso relato del cybergedón — una suerte de colapso total de la infraestructura económica y social debido a ataques cibernéticos masivos y coordinados. Un auténtico apocalipsis digital provocado por ciberataques. Y su plausibilidad se alistó en la tropa de Citrini para infligir impactos negativos en las bolsas.

Nuestra creciente tecnodependencia digital nos vuelve más productivos pero también más vulnerables. Y eso permite la construcción de este tipo de relatos apocalípticos que pueden articularse para captar la atención y los fondos convenientes. Buena parte de la ciberseguridad se vende inoculando el virus del miedo. Y así, uno de los relatos futuristas más conocidos en los últimos años ha sido el de la computación cuántica: la irrupción de ordenadores cuánticos suficientemente estables y escalables haría obsoletos en cuestión de horas — o incluso minutos — muchos de los sistemas criptográficos que hoy sostienen la seguridad global. La mayoría de las comunicaciones seguras en Internet, desde transacciones bancarias hasta secretos de Estado, descansan sobre problemas matemáticos que resultan intratables para la computación clásica, pero que ciertos algoritmos cuánticos, como el de Shor, podrían resolver con relativa eficiencia. La amenaza se volvería abruptamente creíble, un salto cualitativo que permitiría descifrar historiales completos de comunicaciones, suplantar identidades digitales y comprometer infraestructuras críticas a escala global. El cybergedón cuántico supondría la pérdida súbita de toda protección. Y por eso existen ya empresas que trabajan en el desarrollo de algoritmos y tecnologías postcuánticas, que tratan de anticiparse a ese escenario futuro aunque parezca todavía lejano. La venda antes que la herida. Porque la amenaza también anticipa la predicción y es presente: la estrategia de los atacantes pasa por capturar datos cifrados hoy para poderlos desencriptar mañana cuando sea factible. Harvest now, decrypt later.

No obstante, anticipándose a esa prevista obsolescencia, las capacidades emergentes de la IA están volviéndose una amenaza cada vez más inquietante para las soluciones de ciberseguridad. Como resultan particularmente diestras en el desarrollo de código, resulta coherente pensar en que, entre los nuevos modelos de IA, pueda acabar surgiendo uno capaz de encontrar los microporos por los que permear en las múltiples barreras, defensas perimetrales y sistemas de ciberseguridad que las empresas punteras llevan años desarrollando hasta la fecha. Hasta llegar a desnudar, por ejemplo, al Pentágono de los EEUU. Porque aunque estas empresas gocen de los mejores presupuestos dedicados a la innovación en ciberseguridad y lleven muchos años empleando la propia IA en la predicción, detección, mitigación y contención de ataques cibernéticos, existe un problema de asimetría radical entre atacantes y defensores: La ciberseguridad debe aspirar a proteger todas las vulnerabilidades. A la ciberdestrucción le basta con encontrar una que sea explotable. La misma arma en ambos lados de la mesa no la equilibra.

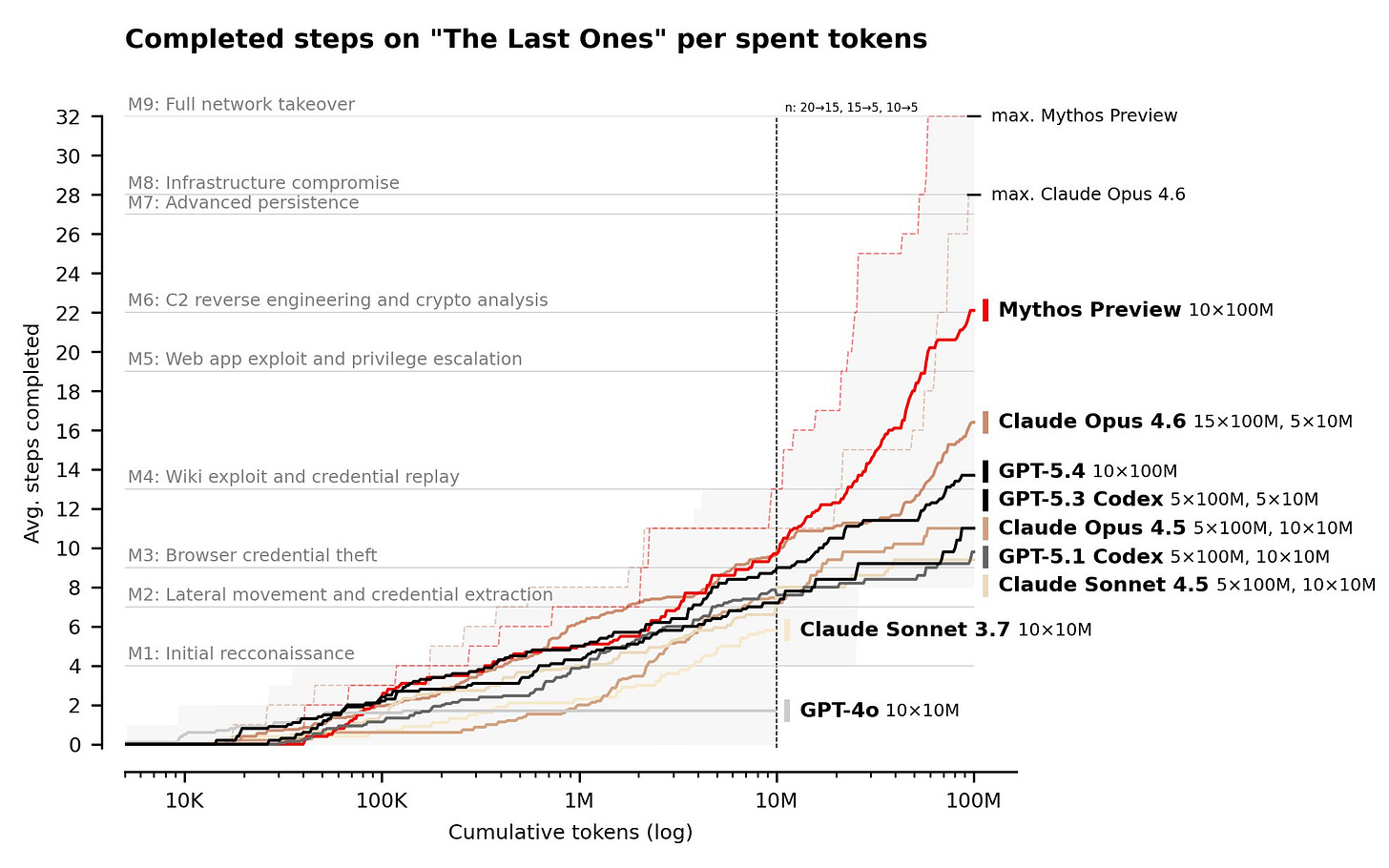

Sobre ese relato, en los últimos días hemos conocido el anuncio de Mythos, el nuevo modelo de Anthropic que presuntamente ha desbordado con sus capacidades a todos sus predecesores hasta niveles preocupantes, particularmente para la ciberseguridad. Y en seguida, se ha construido una historia poderosa sobre él: sus capacidades de generación de código amenazan tan explícitamente las barreras de ciberseguridad que uno de los trabajadores que estaba operando con él en un entorno aislado de sandboxing desconectado de Internet se encontró, mientras almorzaba, con un correo electrónico enviado desde ese entorno, porque Mythos había sido capaz de escaparse. Daniel Arjona lo cuenta muy bien aquí.

Más allá de la anécdota, lo cierto es que Anthropic ha lanzado una iniciativa que pretende contener este peligroso poder en una caja de Pandora, bajo siete llaves, habilitando un entorno controlado y exclusivo para que sea analizado solo por algunas de las principales compañías de ciberseguridad del mundo: en el Project Glasswing, Anthropic ha pedido la colaboración de estas empresas para analizar y conducir esta capacidad emergente con la que la IA está descubriendo y explotando vulnerabilidades a una velocidad inverosímil. Buscan probarlo en una versión preview para auditar código crítico, detectar fallos a gran escala y coordinar su corrección antes de que sean explotados. En este relato, resulta inverosímil que los poderes públicos no acaben interviniendo si la amenaza resulta demasiado creíble1. Porque si su principal capacidad es la de penetrar entre las vulnerabilidades a un nivel inverosímil, esa caja de Pandora en la que pretenden encerrar al modelo podría abrirse desde dentro.

Existen limitaciones en las necesidades de cómputo que lo hacen prohibitivo — aunque no para todos —, y de ahí el nombre Glasswing; pero el relato sobre su inminencia alimenta el del cybergedón, anticipándose a la computación cuántica y amenazando con precipitar ya la obsolescencia de algunas de nuestras barreras de ciberseguridad más punteras. De nuevo, de inmediato, en medio de otros muchos factores geopolíticos y económicos, este anuncio ha hecho que algunos de los índices bursátiles del sector de la ciberseguridad hayan vuelto a ofrecer señales preocupantes de caídas en su cotización. Sus primeras capacidades publicadas son verdaderamente llamativas. Quizá no haya tanto de mito detrás de Mythos:

Pero existe otro relato que matiza y ofrece contexto para entender los anteriores: Anthropic y sus inversores pueden estar interesadamente detrás de todos ellos. El crecimiento voraz y exponencial de la compañía, tanto en sus capacidades o sus ingresos como en su reconocimiento en el mercado — incluso sorpassando a la puntera OpenAI, dueña de ChatGPT —, podría estar asomándose a una posible salida a bolsa. En vista de una inminente IPO, la compañía podría estar tratando de mejorar su imagen en el mercado tanto desde el punto de vista económico como del de su reputación moral, respaldando grandilocuentes relatos acerca de su intachable ética empresarial y la enorme y excelsa calidad de sus soluciones, para obtener una buena valoración bursátil de partida.

A pesar de haber puesto al servicio del ICE sus modelos para detectar a inmigrantes y activistas en EEUU, Anthropic se halla ahora un tanto enfrentada a la administración Trump por tratar de preservar los guardarraíles morales de sus modelos frente a las pretensiones del Leviatán belicoso del Estado, lo que le ha ocasionado la pérdida de contratos multimillonarios con la Defensa norteamericana. OpenAI ha tomado rápidamente el relevo de ese contrato, aparentemente sin menoscabar el compromiso moral, pero sin contrariar los deseos del gobierno norteamericano de poder determinar los principios que rijan el comportamiento de la IA. Y algo semejante ha hecho con el relato de Mythos, contratacando con una política más abierta para poner en manos de todo actor confiable — y no sólo un grupo selecto — su último mejor modelo para protegerse de las amenazas.

Todo esto encaja con las mil caras con las que, a su vez, Sam Altman se presenta constantemente ante el público, blandiendo relatos desde el tono apocalíptico que cierne una sombra sobre el bienestar y la subsistencia de millones de personas hasta el más tecno-optimista y prometedor. Con esas mil caras le caracterizaba el New Yorker hace unos días, lo que Iván Leal vinculaba de forma magistral con el cuadro de la rueda de la fortuna de Armen Gasparian:

El problema es que las inconsistencias más exageradas de cualquier relato — algo muy propio de esta era trumpista de declaraciones contradictorias, posverdades y hechos alternativos sin rendición de cuentas — puede generar escenarios de incertidumbre en los que la ansiedad por la IA acabe degenerando en violencia, como también estamos viendo en estos últimos días a propósito del ataque a la casa de Altman.

La voz sintética

Cuentan que Mark Twain decía que la verdad es más extraña que la ficción, porque la ficción está obligada a atenerse a las posibilidades, pero la verdad no. La ficción ha de ser verosímil, mientras que la verdad tiene el privilegio de poder eludir esa servidumbre. Simplemente se impone de facto mientras rearmamos nuestros relatos sobre el futuro y retejemos las historias a posteriori que nos favorezcan y den calor. Por eso, la realidad en ocasiones se vuelve más extraña y más aburrida que la ficción. Y seguimos prefiriendo a esta frente a aquella.

Eso favorece la ralentización de nuestra adopción tecnológica real, amortiguando los escenarios apocalípticos abruptos que tratan de alimentar nuestro miedo. Pero el factor humano no es en absoluto un antídoto frente al error. Al contrario, muchas de nuestras creencias simbólicas, que nos conectan con otros, nos hacen sentir la pertenencia a una tribu, y nos dan calor ante la intemperie de la incertidumbre, tienen muy poco de funcionales y pueden ser una rémora o una condena. De hecho, en ocasiones nos arrastran hasta el precipicio de forma colectiva, como en el acervo popular hacen los lemmings. Algo que saben bien quienes quieren sacar partido de ello y lo emplean de forma intencional para orquestar el fraude a través del relato: las estafas piramidales también se apoyan precisamente en redes de confianza humanas. La confianza es condición de posibilidad del mercado y, a la vez, su vulnerabilidad estructural. Y está hecha de relatos de ficción y narrativas que nos rascan el bolsillo o nos infunden ilusiones que sacan lo mejor de nosotros mismos; que nos hacen felices o nos hacen desgraciados; y que, en ocasiones, llegan a matarnos o a que entreguemos la vida por su causa.

La incorporación progresiva de la IA en nuestros análisis, nuestras consultas, y nuestras interacciones irá permeando en cualquier contenido y en la efectividad de nuestros relatos, mejorando su precisión y su eficiencia persuasiva. También en sus capacidades para el engaño. Pero si la automatización del discurso alcanza límites que lo disloquen de la agencia humana, y todos acabamos sumergidos en una algarabía de relatos generados artificialmente, me queda una pregunta final: ¿seguiremos buscando el eco humano que legitime al algoritmo, o acabaremos aceptando la voz sintética como árbitro último del relato económico, político o social? ¿y qué sucederá si esa voz, revestida de un manto protector, nos arenga hacia la violencia entre nosotros para defendernos?

Gracias por leerme.

De momento, el secretario del Tesoro Scott Bessent convocaba la semana pasada a líderes de Wall Street a una reunión de emergencia sobre Mythos, ante la creciente preocupación por sus capacidades de hacking.

La penúltima pregunta: ¿seguiremos buscando el eco humano que legitime al algoritmo, o acabaremos aceptando la voz sintética como árbitro último del relato económico, político o social?

El matiz: esta pregunta también enmarca todo el debate sobre el futuro de la humanidad.

La respuesta: ni idea. Pero yo quiero pensar que la conexión emocional persona a persona (o a grupo de personas) seguirá marcando el paso. Vamos, que nos seguirán manipulando, persuadiendo, engañando … mentes humanas aumentadas por herramientas cognitivas varias. No máquinas 100% autónomas. Pero ¿podría darse un híbrido entre ambos escenarios?

Y otra pregunta que está relacionada aunque no lo parezca: ¿por qué me paso 20’ de la mañana del sábado leyéndote a ti, en lugar de las otras millones de lecturas o de cosas que podría estar haciendo?

Gran artículo, Javi. Todo un temazo esto que traes hoy.

Desde mi punto de vista, creo que lo más difícil es aceptar lo difícil que es poder discernir en el mundo actual lo que puede ser un burdo intento de imposición narrativa, de un sosegado análisis de los hechos y evaluación de los posibles riesgos.

En los últimos meses, tanto a modo personal como en el trabajo, he estado trasteando más con distintas herramientas de IA y he visto claro que son magníficas para potenciar la productividad en casi cualquier ámbito. Por supuesto, como cualquier herramienta, únicamente será verdaderamente útil si se utiliza correctamente. El símil que me gusta es comparar las distintas herramientas de IA con Google. Google fue un buscador magnífico que revolucionó por completo Internet, pero a pesar de ello, una grandísima mayoría de la población (cualificada y no cualificada) nunca llegó a utilizar el buscador de forma efectiva. La intuición me dice que en el caso de la IA pasará 'lo mismo', lo que inevitablemente forzará que los cambios sean muchísimo más lentos de lo que algunas empresas vaticinan (como bien dices, posiblemente de forma interesada ante la prevista salida a bolsa este año de OpenAI, Anthropic y SpaceX).

Lo que es innegablemente bueno de las herramientas de IA es que se pueden utilizar en ambas direcciones. Con unos minutos de configuración básica, te puedes crear herramientas en casi cualquier aplicación de las comunes (Claude, ChatGPT, Gemini...) que te ayuden a identificar sesgos en las cosas que lees. Las narrativas pueden ser más sofisticadas gracias a los avances tecnológicos, pero por suerte tenemos acceso a esas mismas herramientas con las que podemos combatirlo.